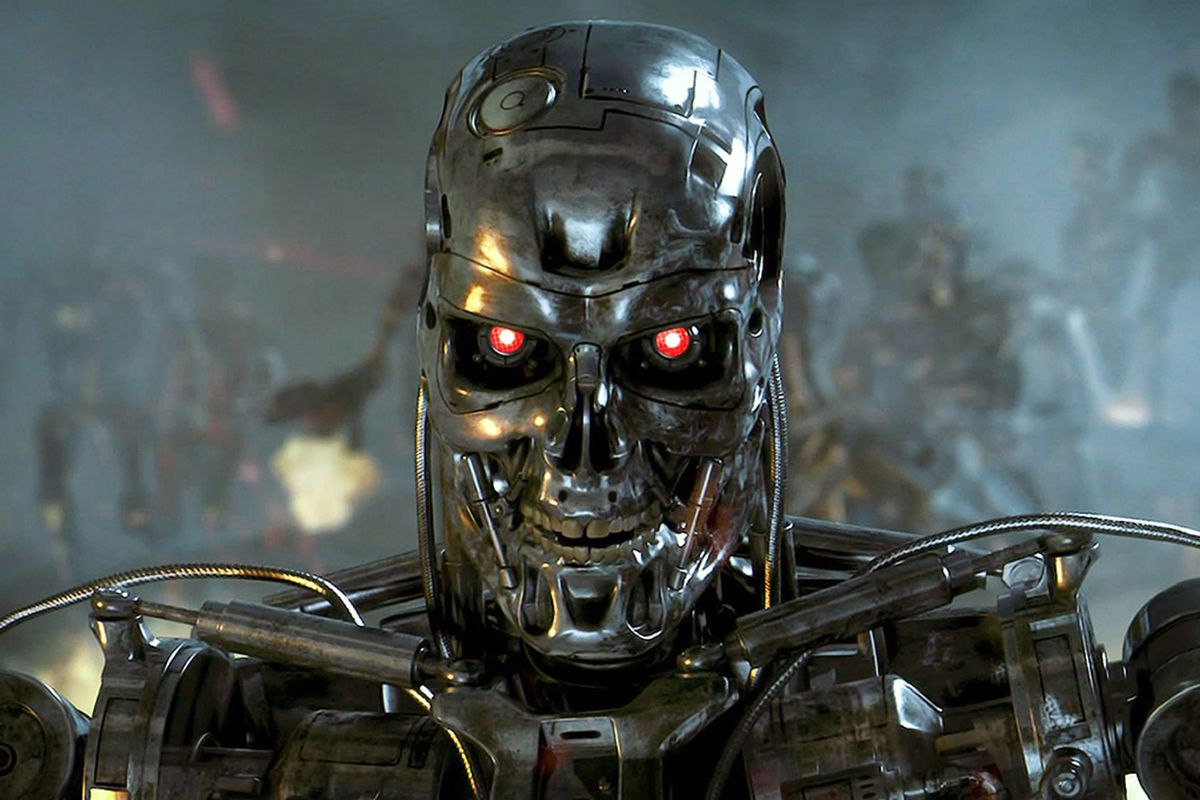

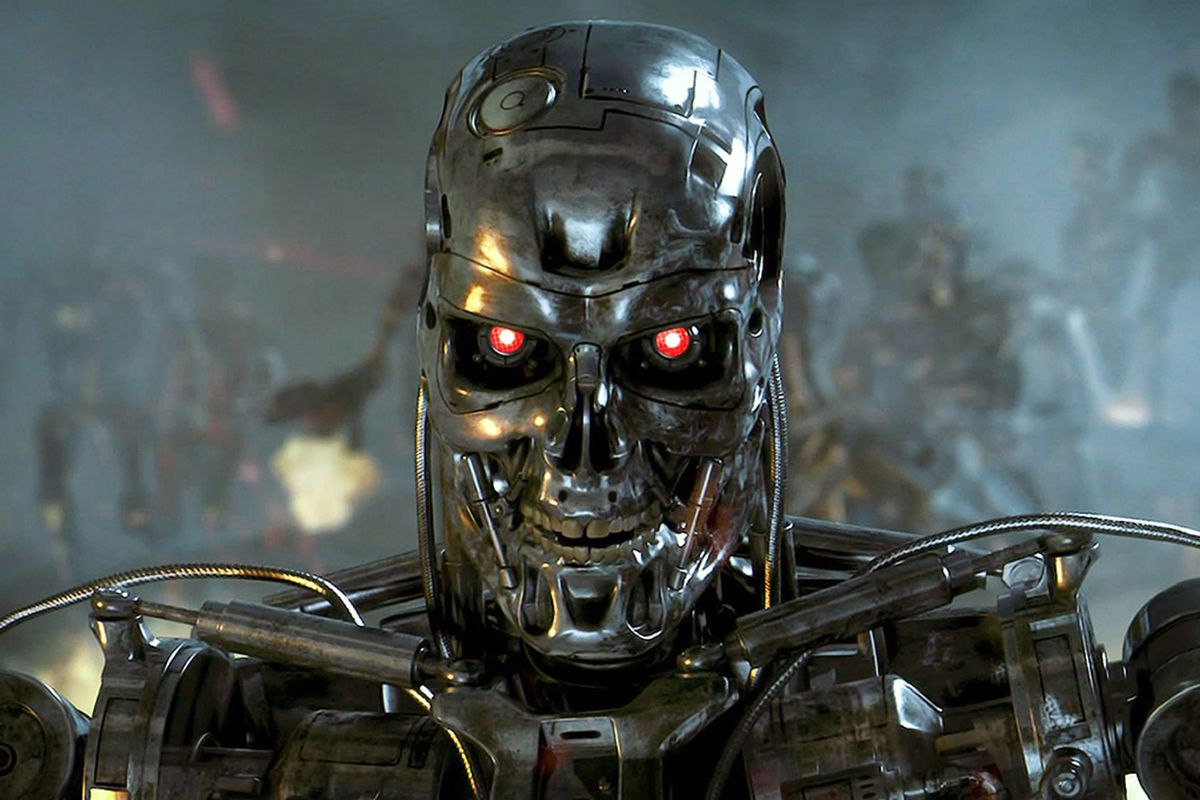

Με ένα δυνατό βουητό, τα μίνι-drones μπαίνουν σαν σίφουνας σε αίθουσα διδασκαλίας, στοχεύουν σε συγκεκριμένους μαθητές και τους πυροβολούν στο κεφάλι. Είναι σκηνή από ταινία φαντασίας που έχουν ανεβάσει στο YouTube οι πολέμιοι των «αυτόνομων όπλων». Χρησιμοποιούν αλγορίθμους για να αναγνωρίσουν τα θύματά τους. Όταν τα βάλουν στο στόχαστρο, δεν μπορούν να ξεφύγουν. Τα μίνι-drones αντλούν τα δεδομένα από τα μέσα κοινωνικής δικτύωσης και είναι δικτυωμένα σε σμήνη. Στο σενάριο, σκοτώνουν μόνο όσους μοιράστηκαν ένα συγκεκριμένο βίντεο.

Απλώς επιστημονική φαντασία;

Το ανησυχητικό φιλμ μικρού μήκους με τίτλο «Slaughterbots» το είδαν πάνω 2.5 εκατομμύρια φορές στο YouTube από όταν ανέβηκε τον Νοέμβριο του 2017. Πρόκειται όμως μόνο για επιστημονική φαντασία και κινδυνολογική παράνοια; Καθόλου, λέει ο Τόμας Κιχενμάιστερ, μέλος της καμπάνιας για την απαγόρευση των αυτόνομων όπλων.

«Είμαστε μόλις ένα βήμα μακριά από κάτι τέτοιο» λέει.

Ο Κιχενμάιστερ είναι στο προεδρείο του Facing Finance, μιας γερμανικής οργάνωσης της διεθνούς καμπάνιας «Stop Killer Robots». Επισκέπτεται συχνά εκθέσεις όπλων για να δει τα προϊόντα και να μιλήσει με τους κατασκευαστές.

Όπλα που μπορούν ως ένα βαθμό να κινηθούν αυτόνομα ανήκουν πλέον στην συνήθη προσφορά. Όπως οι πύραυλοι, που ψάχνουν πιθανούς στόχους τους και τελικά αποφασίζουν μόνοι τους ποιους θα καταστρέψουν. Προς το παρόν ελέγχονται από ανθρώπινο χέρι, αλλά δεν δίνει στρατιώτης την εντολή. Συχνά δεν μπορεί και να τον σταματήσει κανείς.

Ο Κιχενμάιαστερ το βρίσκει εξαιρετικά προβληματικό «γιατί ένα τέτοιο όπλο δεν μπορεί έτσι να κάνει την λεπτή διάκριση ανάμεσα σε στρατιωτικά και πολιτικά οχήματα». Αλλά αυτό ακριβώς προβλέπει το ανθρωπιστικό δίκαιο. Η διάκριση ανάμεσα σε στρατιώτες και αμάχους είναι σημαντικός κανόνας στο δίκαιο πολέμου, που δεσμεύει τα εμπόλεμα μέρη να προστατεύουν τους άμαχους και τα οικήματά τους.

Σε αυτό το πνεύμα η Διεθνής Επιτροπή του Ερυθρού Σταυρού ορίζει ως αυτόνομα όπλα, εκείνα που αναζητούν μόνα τους στόχους, επιτίθενται ή τους καταστρέφουν. Αυτόνομα σημαίνει χωρίς ανθρώπινη ανάμειξη. Και εδώ ακριβώς υπάρχει το πρόβλημα. Τι θα συμβεί, εάν ένας τέτοιος πύραυλος, κατά την αυτόνομη επιλογή του στόχου δεν εξουδετερώσει εχθρικά πυρά, αλλά σκοτώσει και αμάχους; «Δεν είμαστε σε θέση να βάλουμε ένα τσιπάκι με οδηγίες ανθρωπιστικού δικαίου», λέει με νόημα ο Τόμας Κιρχενμάιστερ. Το ότι ο βαθμός αυτονομίας γίνεται συνεχώς μεγαλύτερος, οφείλεται στην ραγδαία πρόοδο στον τομέα της τεχνητής νοημοσύνης και στη ρομποτική.

Τεχνητή νοημοσύνη στην βιομηχανία όπλων

Ο βαθμός αυτονομίας στα οπλικά συστήματα αυξάνεται διαρκώς, χάρη στην ταχεία πρόοδο στους τομείς της τεχνητής νοημοσύνης και ρομποτικής. Οι μηχανές είναι πλέον ικανές να μαθαίνουν. Διαθέτουν εμπειρία μέσω τεχνητών νευρικών δικτύων παρόμοιων με αυτούς του ανθρώπινου εγκεφάλου. Και η βιομηχανία όπλων κάνει χρήση αυτών των ικανοτήτων. Τα όπλα γίνονται πιο γρήγορα και πιο αποτελεσματικά, ενώ ο κίνδυνος για τους στρατιώτες-χρήστες μειώνεται. Αυτό ακριβώς είναι που θέλουν οι στρατοί. Ωστόσο τα όρια είναι ρευστά. Το ρομπότ που αυτόνομα αναζητά, αναγνωρίζει και εξουδετερώνει νάρκες είναι γενικά αποδεκτό, ενώ ένα ρομπότ που αυτόνομα αναζητά, αναγνωρίζει και πυροβολεί ανθρώπους είναι καθαρό ότι αντίκειται στο διεθνές ανθρωπιστικό δίκαιο.

Αλλά πώς εφαρμόζεις το διεθνές δίκαιο σε αυτά τα νέα όπλα; Η διεθνής κοινότητα συζητά για το θέμα στα γραφεία του ΟΗΕ στη Γενεύη από το 2014. Οι συζητήσεις γίνονται μέσα στο πλαίσιο της Διάσκεψης του ΟΗΕ για Συγκεκριμένα Συμβατικά Όπλα (CCW). Οι αρχικές ανεπίσημες συζητήσεις έγιναν επίσημες διαπραγματεύσεις το 2017, με συμμετοχή πάνω από 70 χωρών, καθώς επίσης και επιστημόνων και μη κυβερνητικών οργανώσεων.

Το διάστημα 27 με 31 Αυγούστου 2018, το αντικείμενο συζήτησης είναι τα θανατηφόρα αυτόνομα οπλικά συστήματα (Lethal Autonomous Weapon Systems, LAWS). Μπορεί να είναι ένα ρομπότ, που πολεμά στα πεδία των μαχών, αλλά και μικρά μη επανδρωμένα αεροσκάφη, που δεν υπάρχουν ακόμη βέβαια, αλλά ενδεχομένως στο εγγύς μέλλον. Πολύς χρόνος δεν απομένει. Η διεθνής κοινότητα είναι διαιρεμένη ανάμεσα σε 3 στρατόπεδα. Ανάμεσα σε χώρες που τα πολεμούν και ζητούν απαγόρευση των αυτόνομων όπλων και σε αυτές που προτείνουν μεσαίο δρόμο, ανάμεσά στους η Γερμανία και η Γαλλία. Τέλος, κατά της απαγόρευσης είναι χώρες που επενδύουν πολλά χρήματα στη στρατιωτική χρήση της τεχνητής νοημοσύνης, όπως οι ΗΠΑ, η Ρωσία, το Ισραήλ και η Βρετανία.

Η ουσία του μηνύματος του Ρώσου προέδρου Βλαντιμίρ Πούτιν σε μαθητές τον Σεπτέμβιο του 2017 ήταν ότι όποιος τεθεί επικεφαλής στον τομέα της τεχνητής νοημοσύνης, θα είναι ο κυρίαρχος στον κόσμο. Ο Πούτιν ανησυχεί ότι οι ΗΠΑ ή η Κίνα μπορεί να αναδειχθούν κυρίαρχοι. Για αρκετό καιρό τώρα, η πρόοδος στον τομέα της τεχνητής νοημοσύνη οδηγεί την κούρσα των εξοπλισμών προς τα «εξυπνότερα» αυτόνομα όπλα.

Η αμερικανική κυβέρνηση αυξάνει μαζικά τον αμυντικό προϋπολογισμό. Στον τελευταίο γύρο των διαπραγματεύσεων στη Γενεύη τον Απρίλη παρουσίασε τα αυτόνομα όπλα κάτω από θετικό φως, λέγοντας ότι βοήθησαν στην αποτροπή θανάτου αμάχων και των παράπλευρων απωλειών σε πολέμους. Ισχυρίστηκε ότι ενώ ένας στρατιώτης μπορεί να φορτωθεί από μεγάλο όγκο πληροφοριών στο πεδίο της μάχης, ο υπολογιστής διατηρεί μια σφαιρική άποψη και κάνει λιγότερα λάθη. Η αμερικανική αντιπροσωπεία προειδοποίησε ρητά ότι αυτά τα όπλα δεν πρέπει να στιγματίζονται.

Υπέρ της απαγόρευσης

Μέχρι στιγμής 26 χώρες έχουν κάνει έκκληση για υποχρεωτική απαγόρευση των αυτόνομων όπλων. Πάνω από 230 οργανώσεις και 3000 άτομα υπέγραψαν έκκληση εναντίον των αυτόνομων όπλων μετά από πρωτοβουλία του αμερικανικού Ινστιτούτου για το Μέλλον της Ζωής. Ανάμεσά τους γνωστοί ερευνητές και επιχειρηματίες όπως ο Ελον Μασκ Tesla και η Google Deep Mind. Οι υπογράφοντες δεσμεύτηκαν να μην στηρίξουν την ανάπτυξη των αυτόνομων οπλικών συστημάτων και ζητούν «αυστηρούς διεθνείς κανόνες και νόμους» για την απαγόρευσή τους. Λένε ότι η απόφαση για να σκοτωθεί ένα ανθρώπινο ον δεν μπορεί ποτέ να ανατεθεί σε μία μηχανή.

Σε ένα πράγμα ωστόσο διπλωμάτες και ακτιβιστές συμφωνούν: ο χρόνος τελειώνει. Αυτή είναι και η άποψη του γνωστού επιστήμονα Στιούαρτ Ράσελ που ερευνά την τεχνητή νοημοσύνη για 35 χρόνια. Ήταν εκείνος που είχε την ιδέα για το φιλμ «Slaughterbots». Ενα τέτοιο σενάριο μπορεί ακόμα να σταματήσει, αλλά «το παράθυρο ευκαιρίας κλείνει γρήγορα» προειδοποιεί. Οι στρατοί ήδη πειραματίζονται με σμήνη drones, ενώ λαλλοι, όπως ο γερμανικό, αναπτύσσει όπλα για να αμυνθεί εναντίον τους. Αν οι συζητήσεις στην Γενεύη δεν μπορέσουν να κάνουν πρόοδο, ο Κιρχενμάιστερ προβλέπει ότι η πιεση από την κοινωνία των πολιτών θα αυξηθεί.

Μια συμφωνία για την απαγόρευση των αυτόνομων όπλων μπορεί τότε να γίνει εκτός ΟΗΕ, όπως έγινε και με τον αγώνα ενάντια στις νάρκες. Η διεθνής καμπάνια για την απαγόρευσή τους είχε πάρει το βραβείο Νόμπελ Ειρήνης το 1997.